免费咨询ASO专家

初次接触ASO或者不知道如何定向优化您的应用?

我们提供应用推广专家一对一定制化服务

Google Play AI新规落地,开发者面临三重合规风暴

2025-07-25

平台责任穿透、强制披露与区域合规差异,正重构移动AI生态的游戏规则。

7月11日,Google Play正式将“AI生成内容政策”纳入《开发者计划政策》核心条款,标志着全球最大的应用分发平台首次将AI技术纳入明确的合规框架。新规要求所有使用AI生成文本、图像、视频或语音的应用必须承担内容责任,并在显著位置披露技术使用细节。

这一政策变化正值AI内容在移动应用中爆发式增长的关键节点。据Statista数据,2025年全球AIGC应用下载量同比激增320%,但伴随而来的虚假信息、版权争议和欺诈案例也同比上升280%。

全球AI治理浪潮下的必然之举

政策出台绝非孤立事件,而是全球AI监管趋严的缩影。

-

美国FTC同期发布的《生成式AI责任指南》则明确,即使AI模型开源,开发者仍需为下游应用的内容负责。

-

这种“风险分级+全链条追责”的治理模式正在成为全球共识。Play Store数据显示,2025年上半年因AI内容违规下架的应用数量同比增加190%,其中金融、医疗和儿童教育类应用占比超65%。

-

某理财应用使用AI生成虚假用户评价,导致2.3万用户受骗,最终引发集体诉讼,此类事件迫使Google从“事后处罚”转向“事前预防”。

-

科技巨头纷纷布局AI治理话语权。苹果在2025年WWDC大会推出《AI应用开发白皮书》,要求所有使用Core ML的应用必须通过“伦理审查委员会”认证;Meta则对AI生成广告实施“双盲审核”机制。

欧盟《AI法案》将于2025年8月2日正式实施,将生成式AI列为“高风险”类别,要求企业提交技术文档并接受第三方审计。Google此举意在通过规则制定争夺全球AI治理主导权,为其Vertex AI开发者生态铺路。

政策三重利刃:责任、披露与穿透性合规

-

责任归属的绝对性:避风港原则崩塌

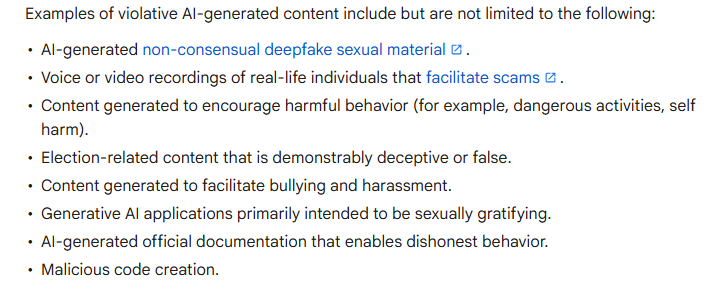

新政策打破了传统“避风港原则”的适用边界。无论AI生成内容是由开发者直接使用还是用户通过UGC功能产生,应用所有者均需承担内容合规的主体责任。

若用户通过某社交应用生成的AI图像涉及侵权或暴力内容,平台有权直接下架应用并追究开发者责任。这一规则将内容审核压力从平台彻底转移至开发者。

-

披露义务的强制性:透明度的代价

应用必须在Play Store详情页、隐私政策和用户协议中明确标注AI技术的使用场景。金融类应用若使用AI生成投资建议,需在功能介绍中添加 “本服务包含AI分析,不构成专业投资建议” 的警示语。

Google特别要求披露内容需“易于理解”,禁止使用模糊表述如“部分内容由先进技术生成”。建议采用欧盟《AI法案》推荐的“黑底黄字”警示格式,以满足“显著位置+清晰语言+多场景覆盖”三重标准。

-

合规标准的穿透性:AI不是法外之地

AI生成内容不得规避现有政策,包括虚假广告、色情暴力、医疗欺诈等。医疗类应用若使用AI生成健康建议,即使标注“仅供参考”,仍需符合各国医疗广告法规,否则可能触发欧盟《AI法案》中的“不可接受风险”条款。政策明确,即使AI生成内容仅存在“潜在风险”(如误导性暗示),也可能被认定为违规。

开发者生存危机:五大雷区与千万罚款

-

金融、医疗和教育类应用首当其冲

金融类应用若使用AI生成投资建议,需在提审时提交算法透明度报告和第三方审计证明,审核周期可能从7天延长至21天。

-

技术合规要求显著提高

开发者需为AI生成内容提供“数字水印”和“训练数据溯源链”。某新闻应用因无法证明AI生成文本未抄袭路透社报道,被判定为违规。某图像生成应用因使用盗版素材库,被Adobe起诉索赔1200万美元。

-

披露场景复杂化

除应用商店外,还需在启动页、功能入口和用户协议中嵌入AI使用说明。某社交应用因仅在隐私政策末尾标注AI图像生成功能,被欧盟罚款250万欧元。

-

用户生成内容(UGC)成为高危地带

若允许用户生成AI内容,需建立“预审+实时过滤+用户举报”三级机制。某写作工具因用户使用AI生成盗版小说,被法院判定需赔偿原作者500万美元。

-

区域合规差异构成全球化难题

沙特要求所有AI生成内容不得涉及宗教元素,而印度则禁止使用AI生成政治人物形象。某游戏公司因未及时响应韩国对AI生成角色外观的新规,导致产品推迟上线6个月。

合规生存指南:从被动防御到主动适配

-

高风险领域的战略撤退与防守

避免在医疗、金融、新闻等领域使用AI自动生成核心内容。某健康应用将AI功能限定为症状自查辅助,而非诊断建议,成功通过欧盟审核。对于必须使用AI的场景,可采用 “人机协作”模式。

例如某翻译应用要求AI生成结果必须经专业译员审核,既提升效率又降低风险。

-

技术风控与透明化披露

采用“AI审核+人工复核”组合方案。某电商平台引入Google Perspective API过滤仇恨言论,同时保留5%的人工抽检比例。确保训练数据来源合法,避免使用未经授权的公开数据。

参考欧盟《AI法案》推荐的“四要素模型”:技术类型、使用场景、数据来源、风险提示。某教育应用在详情页添加“本课程部分内容由AI生成,教师团队全程监制”的标注,显著降低用户投诉率。若AI功能升级,需同步更新披露内容。

-

全球化合规架构搭建

针对不同市场配置差异化内容策略。某社交应用在欧盟版本中禁用AI图像生成功能,而在东南亚市场保留但加强审核。在重点市场(如欧盟、韩国)设立专职合规岗位,实时跟踪政策变化。

开发者为AI生成内容提供“数字水印”和“训练数据溯源链”将成为基本要求。

结论:合规能力成为AI开发者的新分水岭

Google此次政策调整传递出清晰信号:平台对AI的态度已从“鼓励创新”转向“可控发展”。正如OpenAI在意大利被罚后通过合规整改重新获得市场信任的案例所示,合规不应被视为成本,而应转化为品牌竞争力。

未来的AI应用开发,将是技术能力、法律素养和全球化视野的综合较量。开发者需建立全链路内容风控体系,包括预生成审核、实时拦截和事后追溯机制,以应对绝对责任时代的内容治理挑战。

欧盟AI法案8月2日生效在即,全球监管框架的快速成型正在重塑移动应用生态。

面对复杂的政策环境,开发者可借助AppFast专业元数据诊断工具,快速识别商店页潜在风险(如违规关键词、评级不匹配),并生成优化建议。点击立即诊断,一键提升应用合规性与曝光率,从容应对Google Play政策挑战。